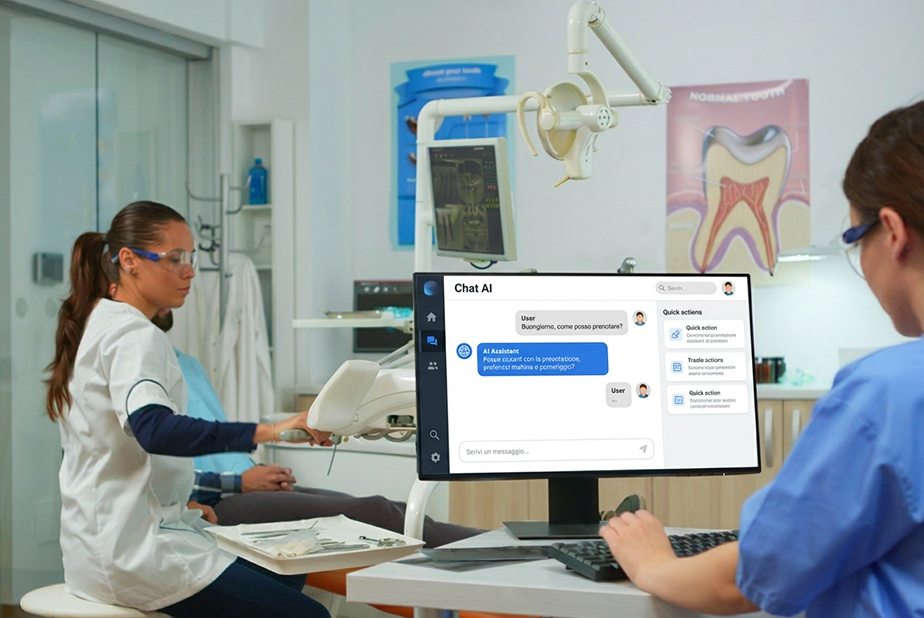

Proprio per comprendere quanto i moderni chatbot siano realmente in grado di fornire risposte utili, accurate e comprensibili, un gruppo di ricercatori dell’Università della Giordania ha condotto uno studio comparativo su quattro dei modelli linguistici più avanzati attualmente disponibili: ChatGPT-4o, Google Gemini, DeepSeek R1 e il modello specialistico DentalGPT.

Il risultato è un’analisi sistematica che offre una fotografia aggiornata del ruolo dell’AI nell’educazione del paziente in odontoiatria estetica.

Gli autori hanno preso in esame 109 domande reali formulate da pazienti sul tema dello sbiancamento dentale, selezionate attraverso piattaforme di ricerca di query come Answer the Public e People Also Ask. Le domande sono state suddivise in cinque categorie cliniche rilevanti (tecniche e agenti, sicurezza, istruzioni, indicazioni/controindicazioni, durata e costi) e sottoposte ai quattro chatbot.

Le risposte sono state poi valutate da due specialisti certificati, utilizzando criteri standardizzati:

- Usefulness (utilità),

- Global Quality Scale (GQS) per la qualità,

- CLEAR score per la completezza e affidabilità,

- Flesch-Kincaid e SMOG index per la leggibilità.

Il primo dato rilevante è la qualità complessivamente elevata delle risposte. Secondo i valutatori:

- il 68% delle risposte è classificato come “molto utile”;

- nessuna risposta è risultata “non utile” o fuorviante;

- non emergono differenze significative tra i modelli.

Questo suggerisce che, almeno per un tema standardizzato come lo sbiancamento dentale, le AI riescono a fornire contenuti affidabili e coerenti con quanto un professionista comunicherebbe a un paziente.

Le valutazioni qualitative confermano la solidità dei modelli:

- il punteggio medio GQS è 3,9 su 5,

- il punteggio medio CLEAR è 22,5 su 25, con oltre il 92% delle risposte considerate “molto buone”.

Anche in questo caso, nessuna differenza clinicamente rilevante tra chatbot: tutti i modelli si sono dimostrati costanti in accuratezza e appropriatezza delle informazioni.

Nonostante la buona qualità dei contenuti, la leggibilità delle risposte rappresenta un ostacolo significativo:

- il Flesch Reading Ease score medio è 36, classificato come “difficile”;

- il punteggio SMOG medio è 11, equivalente a una capacità di lettura di fine scuola superiore.

In altre parole, pur essendo accurate, molte risposte risultano troppo complesse per un paziente medio, che spesso ha un livello di alfabetizzazione sanitaria inferiore.

Gli autori sottolineano come questo limite sia ricorrente nella comunicazione sanitaria basata su AI e possa creare barriere informative per le fasce più vulnerabili della popolazione.

Un risultato interessante riguarda il confronto tra i modelli generalisti e DentalGPT, specifico per l’odontoiatria: il modello specialistico non supera significativamente gli altri, probabilmente perché lo sbiancamento è un tema molto documentato nella letteratura comune, accessibile anche ai modelli non specializzati.

Lo studio conferma il potenziale dei chatbot come strumenti complementari nell’educazione del paziente:

- risposte coerenti, affidabili e accurate,

- utili per chiarire dubbi preliminari sul trattamento, sui rischi e sulle indicazioni,

- disponibili 24/7 con un linguaggio chiaro e ragionato.

Tuttavia, gli autori ribadiscono che l’AI non sostituisce la valutazione clinica, soprattutto per condizioni individuali come sensibilità dentinale, difetti dello smalto o aspettative estetiche specifiche. Inoltre, la comprensibilità va migliorata: senza un adeguato livello di leggibilità, anche l’informazione più accurata rischia di non essere fruibile.

I modelli ChatGPT-4o, Gemini, DeepSeek R1 e DentalGPT dimostrano una notevole efficacia nel rispondere a domande dei pazienti sullo sbiancamento dentale, con risultati uniformi in termini di utilità, qualità e affidabilità. Rimane però un punto critico: la necessità di generare contenuti più semplici, accessibili e adattati ai diversi livelli di alfabetizzazione sanitaria.

L’IA rappresenta dunque un valido supporto alla comunicazione odontoiatrica, ma richiede un ulteriore passo verso la semplificazione linguistica, per garantire che ogni paziente possa davvero comprendere e utilizzare le informazioni ricevute.